Ressources

Le blog Statlift

Méthodologie statistique, cas d'usage par verticale, CRO et études de cas terrain. Production éditoriale du Studio Statlift, par des praticiens de l'expérimentation web.

-

Comparatifs

ComparatifsTop 10 outils d'A/B testing en 2026 : le comparatif honnête (testé sur 6 mois)

Comparatif méthodique de 10 plateformes AB testing — VWO, AB Tasty, Kameleoon, Optimizely, Convert, GrowthBook, Statsig, Eppo, Adobe Target, Statlift. Notation /10 sur 6 critères pondérés.

Studio Statlift · -

Études de cas & Retours

Études de cas & RetoursMaison Loriot : +23 % de taux de conversion en 6 mois grâce à 14 tests

DNVB mode FR (800 K visiteurs/mois), Maison Loriot a augmenté sa conversion de 23 % en 6 mois via 14 tests A/B priorisés au framework PXL. Méthodologie, 3 tests gagnants détaillés, 2 échecs honnêtes.

Studio Statlift · -

Optimisation conversion (CRO)

Optimisation conversion (CRO)Heatmaps + A/B testing : le combo qui fait passer votre CRO au niveau supérieur

Les heatmaps seules génèrent des fausses hypothèses. Combinées à l'AB testing, elles deviennent le combo gagnant : insight visuel → hypothèse causale → preuve statistique.

Studio Statlift · -

Études de cas & Retours

Études de cas & RetoursOctoTribe : 1,4 M€ de revenus additionnels grâce à UN test A/B sur la pricing

SaaS B2B logistique mid-market, OctoTribe a fait monter sa conversion trial-to-paid de 18,4 % en inversant l'ordre des colonnes de sa pricing page. Méthodologie, chiffres, limites.

Studio Statlift · -

Cas d'usage & Verticales

Cas d'usage & VerticalesA/B tester ses pages produit Shopify : 12 hypothèses qui marchent (et 3 qui ratent toujours)

12 zones à tester en priorité sur vos fiches produit Shopify, classées par potentiel et effort. Plus 3 anti-patterns qui dégradent systématiquement la conversion.

Studio Statlift · -

Optimisation conversion (CRO)

Optimisation conversion (CRO)User research avant A/B test : le workflow qui divise par 2 le taux d'échec

70 % des tests A/B sortent flat. Le filtre user research upstream — interviews, surveys, usability tests, sessions — réduit drastiquement ce ratio en éliminant les hypothèses sans fondement.

Studio Statlift · -

Études de cas & Retours

Études de cas & RetoursL'échec qui nous a appris plus que dix succès : autopsie d'un test à six chiffres

Un test 'gagnant' à +18 % apparent, déployé en grande pompe, qui s'est effondré 6 semaines après en production. Les 4 erreurs identifiées en post-mortem et ce que ça change durablement.

Studio Statlift · -

Cas d'usage & Verticales

Cas d'usage & VerticalesOptimiser l'onboarding SaaS via A/B tests : le framework Aha-moment 2026

Un framework en 5 leviers pour cadrer vos tests d'onboarding SaaS : signup, activation, feature discovery, value moment, retention. Avec exemples de tests par étape et métriques à instrumenter.

Studio Statlift · -

Optimisation conversion (CRO)

Optimisation conversion (CRO)Conversion funnel : les 4 fuites majeures que vos tests A/B doivent attaquer en priorité

Le funnel TOFU/MOFU/BOFU a 4 fuites types : signup friction, pricing hesitation, payment abandon, post-purchase silence. Diagnostic et tests prioritaires par fuite.

Studio Statlift · -

Méthodologie & Statistiques

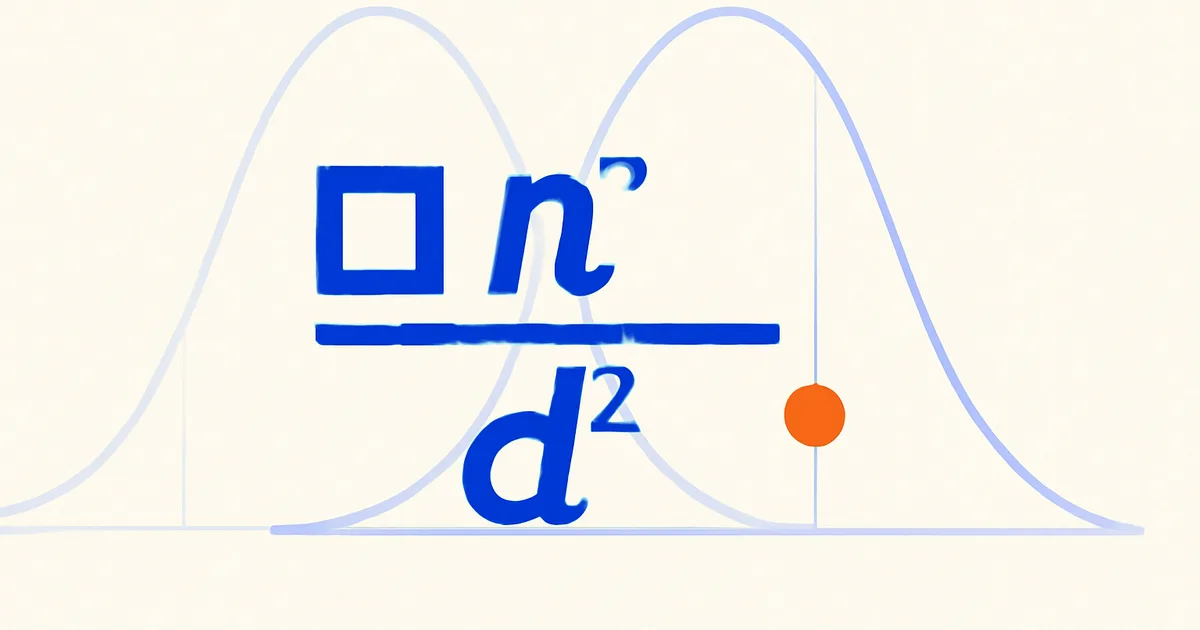

Méthodologie & StatistiquesCalculer la taille d'échantillon d'un test A/B : la méthode pas-à-pas

Sample size, MDE, power, alpha — la formule du Z-test à deux proportions expliquée pas à pas, avec un exemple chiffré e-commerce et l'outil intégré pour calculer en 30 secondes.

Studio Statlift · -

Études de cas & Retours

Études de cas & RetoursLe test qui a contredit notre intuition (et 8 mois pour s'en remettre) — interview avec Léa Pernaud

Léa Pernaud, Head of Growth Maison Loriot, raconte le test du CTA rouge vs vert qui a contredit l'intuition de toute son équipe, la résistance interne au déploiement, et ce que ça a changé dans leur process décisionnel.

Studio Statlift · -

Cas d'usage & Verticales

Cas d'usage & VerticalesA/B tester sa pricing page SaaS : 5 patterns gagnants (et 2 qui détruisent la confiance)

5 patterns prouvés sur les pricing pages SaaS B2B (toggle annuel, ancrage, social proof, structure, comparison table) et 2 anti-patterns courants (sur-discount, fake scarcity).

Studio Statlift · -

Études de cas & Retours

Études de cas & RetoursRetour sur 200 tests menés en 2025 : ce que les stats nous ont appris (et ce que VWO+AB Tasty ne disent pas)

Méta-analyse de 200 tests AB menés en 2025 sur 80 sites FR (e-commerce + SaaS B2B + média). La règle empirique du 1/3, les 5 patterns récurrents, et pourquoi le merger VWO+AB Tasty 2026 change tout.

Studio Statlift · -

Optimisation conversion (CRO)

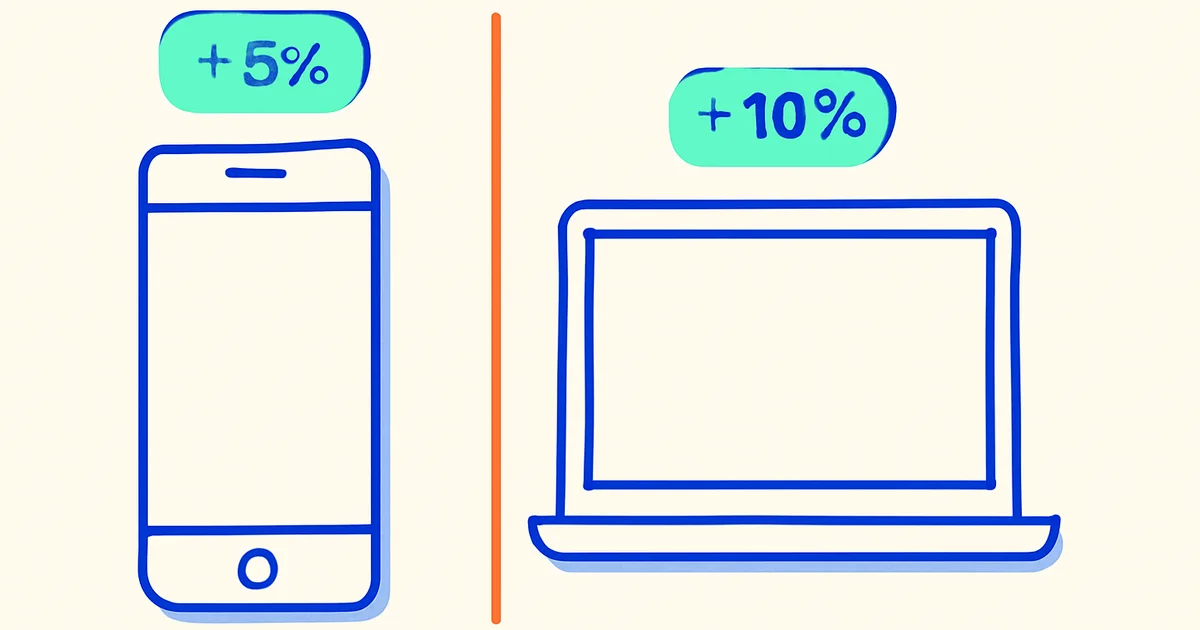

Optimisation conversion (CRO)Mobile vs desktop : pourquoi vous devez A/B tester séparément (et comment)

Tester en bloc tous devices confondus dilue le signal mobile (souvent dominant). Comment splitter votre trafic, quelles métriques par device, et les pièges classiques.

Studio Statlift · -

Cas d'usage & Verticales

Cas d'usage & VerticalesLanding pages B2B : 8 hypothèses à tester en priorité (cycle d'achat long)

Sur un cycle B2B 3-9 mois, l'optimisation landing demande des hypothèses différentes du B2C. 8 tests prioritaires : form length, ROI calculator, social proof B2B, demo vs trial CTA, vidéo.

Studio Statlift · -

Méthodologie & Statistiques

Méthodologie & StatistiquesFréquentiste vs Bayésien : quel framework choisir pour vos tests A/B ?

Les deux écoles statistiques principales en A/B testing, comparées sur 6 critères. Quand basculer du fréquentiste au bayésien, et pourquoi Statlift expose les deux en parallèle.

Studio Statlift · -

Optimisation conversion (CRO)

Optimisation conversion (CRO)A/B testing et SEO : sont-ils vraiment compatibles ? Le verdict 2026

Le mythe du duplicate content qui pénalise les tests AB est mort depuis 10 ans. Position officielle Google, best practices techniques (canonical, rel=alternate, noindex), erreurs qui déclenchent une pénalité réelle.

Studio Statlift · -

Cas d'usage & Verticales

Cas d'usage & VerticalesFormulaires d'inscription : 6 variantes qui convertissent et 3 qui sabotent

Le form signup est un goulot mesurable. 6 variantes gagnantes (single-field, multi-step, social proof inline, etc.) et 3 anti-patterns qui dégradent la conversion sans qu'on le voit.

Studio Statlift · -

Méthodologie & Statistiques

Méthodologie & StatistiquesA/A test : la pratique qui révèle les biais cachés de votre outil d'AB testing

Le test A/A (variantes identiques) est l'outil de validation le plus sous-utilisé de l'A/B testing. Pourquoi 60 % des plateformes échouent en silence, et comment l'implémenter correctement.

Studio Statlift · -

Méthodologie & Statistiques

Méthodologie & StatistiquesPeeking, sequential testing et SRM : les 3 pièges statistiques qui faussent vos résultats

Peeking inflate l'erreur de type I. Le sequential testing résout ce problème. Le SRM signale qu'un test est techniquement cassé. Comment ces 3 concepts liés sauvent vos décisions.

Studio Statlift · -

Méthodologie & Statistiques

Méthodologie & StatistiquesMulti-armed bandit vs split test classique : quand choisir lequel ?

Allocation fixe (split classique) vs allocation adaptative (bandit) — les deux méthodes ont leur place. Dilemme exploration/exploitation, cas où le bandit gagne, cas où il perd.

Studio Statlift ·

Lancez votre premier test cette semaine.

Plan Découverte gratuit, sans carte bancaire. Calculez votre échantillon, déployez, mesurez la signification — en moins de 2 heures.

Sans carte bancaire · Hébergement UE · Conformité RGPD attestée