Sur la plupart des sites FR en 2026, mobile représente 60-80 % du trafic, parfois plus en e-commerce mode/lifestyle (90 % chez Maison Loriot par exemple). Pourtant, beaucoup d’équipes lancent leurs tests en “all devices” et regardent le résultat agrégé.

Erreur de méthode : ce résultat agrégé peut masquer un winner mobile + un perdant desktop, ou inversement. Conclusion : déploiement sub-optimal. Voici comment splitter proprement et que mesurer.

Pourquoi tester séparément

Différence d’UX mobile vs desktop

| Aspect | Desktop | Mobile |

|---|---|---|

| Interaction | Hover possible, large viewport | Touch only, scroll dominant |

| Attention span | Plus longue | Plus courte (interruptions) |

| Contexte d’usage | Bureau, calme | Public, distrait, debout |

| Force du CTA | Souvent secondaire visuellement | Critique (doit dominer) |

| Form completion | Plus facile | Plus pénible (clavier) |

| Photos qualité | Critère majeur | Moins critique (zoom) |

| Profondeur de scroll | Plus haute | Plus basse |

Un changement qui marche desktop peut faire mal en mobile. Ou inversement.

Exemple concret

Test chez Sephora EU 2023 : changement du hero PDP, photo “tactique” → “lifestyle”.

Résultat agrégé : +4 %, p = 0,06 (à la limite de la signification).

Résultat segmenté :

- Desktop : +12 %, p < 0,01 (winner net)

- Mobile : -3 %, p = 0,3 (perdant légèrement, non-significatif)

Décision sans segmentation : on aurait sans doute déployé sur tous. Mauvaise décision, on aurait dégradé 75 % du trafic (mobile dominant).

Décision avec segmentation : déployé sur desktop uniquement, conservé l’original sur mobile. Gain net : +12 % sur 25 % du trafic = +3 % global, vs 0 % sans segmentation.

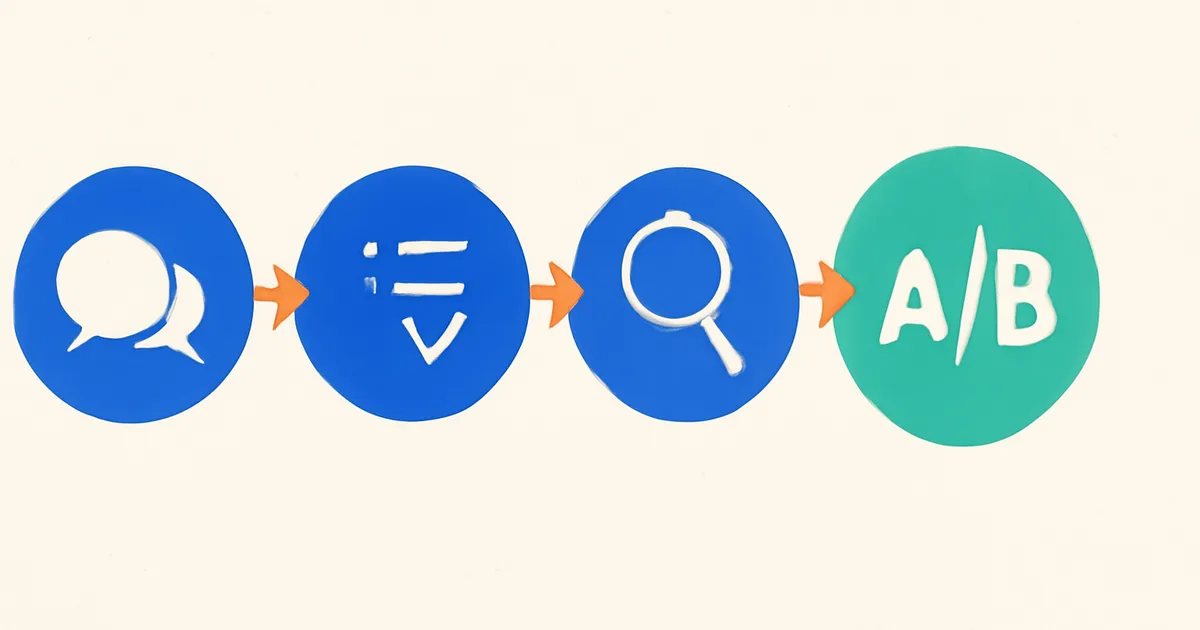

Comment splitter proprement

Option 1, Deux tests séparés (recommandé)

Setup :

- Test 1 : variante A vs variante B, targeting mobile uniquement (User-Agent mobile)

- Test 2 : variante A vs variante B, targeting desktop uniquement

- Lancés en parallèle

Avantages : sample size calculé par device, statistiques propres, conclusion claire.

Inconvénient : deux tests à gérer = plus de complexité.

Option 2, Un test, segmentation à l’analyse

Setup : 1 seul test, targeting all devices, mais analyse post-test segmentée par device.

Avantage : 1 seul test à gérer.

Risque : sous-puissance sur le segment minoritaire. Si vous avez 80 % mobile / 20 % desktop, votre segment desktop atteint la signification 4x plus lentement. Vous pourriez kill le test avant la conclusion desktop.

Solution : calculer le sample size en fonction du segment le plus petit. Test = 4x plus long. Soit séparer (option 1).

Métriques à mesurer par device

Différentes par device :

Desktop

- Conversion finale (signup, achat)

- Profondeur de scroll (mesure d’engagement)

- Time on page

- Page views per session (recirculation)

Mobile

- Tap accuracy (les utilisateurs cliquent sur la bonne zone)

- Time to first interaction

- Mobile drop-off à un step précis (souvent le form le plus pénible)

- Conversion finale (souvent inférieure desktop, normal)

Mobile-only signaux

- Rage taps (signal de frustration)

- Pinch-to-zoom (signal que le contenu est trop petit)

- Orientation changes (rotation portrait/paysage = signal d’inconfort viewport)

Les pièges classiques

Piège 1, Croire qu’un site responsive = test adapté mobile

Faux. Un site responsive s’affiche sur mobile, mais les interactions (CTA size, touch targets, form behavior) ne sont pas testées. Un test sur le wording du CTA peut être confondu par la taille du CTA mobile (qui n’a pas été testée).

Solution : tester explicitement la version mobile de la variante.

Piège 2, Ignorer les tablettes

Tablettes = ~3-7 % du trafic. Souvent considérées comme mobile par les outils analytics, mais elles se comportent plus comme desktop (viewport large, hover possible via stylus, etc.).

Solution : 3 segments si volume suffisant (mobile / tablet / desktop) ou agréger tablet avec desktop.

Piège 3, Variantes incompatibles techniquement mobile

Vous testez une popup desktop. Sur mobile, elle prend 100 % de l’écran et bloque la lecture. Drop-off massif.

Solution : variantes différentes par device. La variante mobile peut être un bottom sheet au lieu d’une popup full screen.

Cas e-commerce, mobile en priorité

Si vous êtes en e-commerce avec ≥ 70 % de trafic mobile :

- Concevez d’abord pour mobile (mobile-first design).

- Testez d’abord en mobile (sample size atteint plus vite).

- Adaptez desktop ensuite (pas l’inverse).

Cas SaaS B2B, desktop en priorité

Si vous êtes en SaaS B2B :

- Trafic majoritairement desktop (les acheteurs B2B sont au bureau).

- Testez d’abord desktop (volume + valeur transactionnelle).

- Mobile = exploration / pre-research des prospects, moins critique pour la conversion immédiate.

Sur Statlift

Targeting device intégré : à la création du test, sélectionnez “Mobile”, “Desktop”, “Tablet”, “Tous”. Métriques par device affichées en parallèle dans le dashboard de résultats.

Sur le plan Pro, vous pouvez lancer deux variantes différentes par device dans un même test (Variant B-mobile différent de Variant B-desktop), utile pour adapter les variantes au contexte.

En résumé

| Recommandation | Effort | Bénéfice |

|---|---|---|

| Splitter mobile vs desktop dans tous vos tests | Bas | Évite les fausses décisions sur 25-30 % des tests |

| Calculer sample size par device | Bas | Statistiques fiables |

| Métriques différentes par device | Moyen | Insight plus riche |

| Variantes adaptées par device | Élevé | Optimum pour chaque contexte |

Trois règles de pouce :

- Toujours segmenter mobile vs desktop dans l’analyse. Toujours.

- Sur mobile dominant, lancez le test mobile-first ; testez desktop ensuite si nécessaire.

- Mesurez les signaux mobile spécifiques (rage taps, pinch-zoom, drop-off form), pas seulement la conversion globale.

Pour les fuites funnel : Conversion funnel, 4 fuites majeures. Pour le combo qualitatif : Heatmaps + A/B testing.