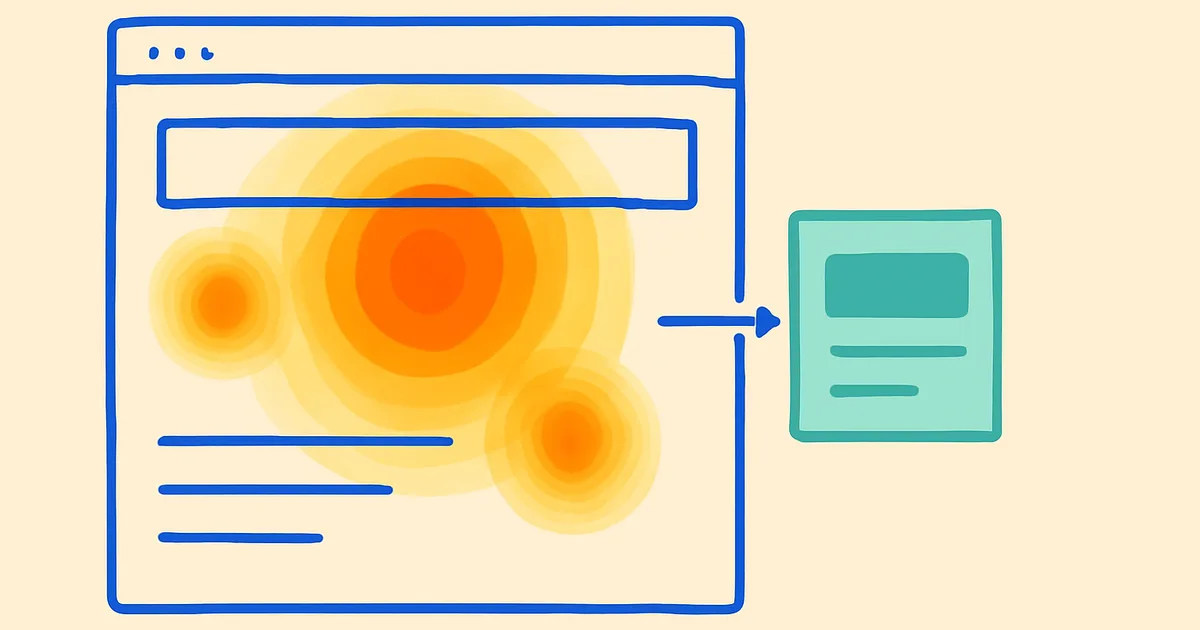

Les heatmaps (Hotjar, Microsoft Clarity, FullStory) sont l’outil le plus utilisé en CRO. Et le plus mal utilisé. La plupart des équipes les utilisent pour prendre des décisions alors qu’elles devraient les utiliser pour générer des hypothèses à tester.

Voici le workflow combiné qui transforme une heatmap en boucle CRO mesurable : insight visuel → hypothèse causale → A/B test → décision.

Pourquoi les heatmaps seules génèrent des fausses hypothèses

Une heatmap vous montre où les gens cliquent, scrollent, hover, hésitent. Elle vous montre des patterns observés. Elle ne vous montre pas la cause ni ce qui se passerait si vous changiez quelque chose.

Exemple vécu chez Sephora EU en 2022 :

- Heatmap PDP : 23 % des clics sur la photo produit hero (logique).

- Conclusion intuitive : “les gens veulent zoomer, ajoutons un zoom !”

- A/B test du zoom : flat, p = 0,7. Aucun impact mesurable.

Pourquoi ? Parce que les clics sur l’image n’étaient pas une intention de zoom mais une désorientation (les gens cliquaient au hasard en cherchant le CTA). Ajouter un zoom n’a pas résolu la désorientation.

Sans A/B test, on aurait déployé un feature inutile qui coûte du dev pour zéro impact business.

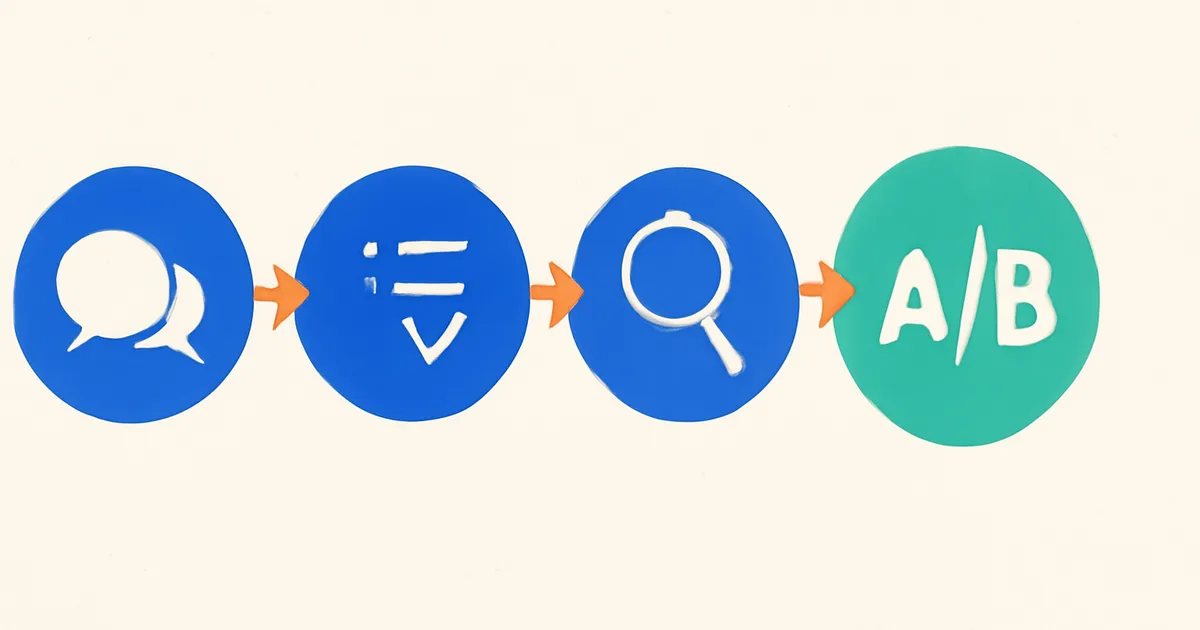

Le workflow combiné en 4 étapes

Étape 1, Heatmaps + session recordings (observation)

Outil : Microsoft Clarity (gratuit, suffisant pour 80 % des cas) ou Hotjar (payant, plus de granularité).

Période d’observation : 2-4 semaines minimum pour avoir un signal stable.

Ce que vous cherchez :

- Click maps : zones cliquées (chaudes vs froides). Cliques sur éléments non-cliquables = signal de confusion ou de besoin non-comblé.

- Scroll maps : profondeur de scroll. Si 90 % des gens s’arrêtent avant votre CTA, c’est un problème de layout.

- Movement maps (= attention) : où le pointeur traîne. Approximation faible mais utile.

- Session recordings : 20-30 enregistrements visuels d’utilisateurs réels. Repérez les patterns de friction : retours en arrière, formulaires abandonnés, rage clicks.

Étape 2, Formulation d’hypothèses

À partir des insights, écrivez 3-5 hypothèses testables au format :

“Nous pensons que [changer X en Y] va [améliorer la métrique Z] parce que [insight observé dans la heatmap / recording].”

Exemples concrets :

- “Nous pensons que remonter le CTA “Ajouter au panier” au-dessus du fold va augmenter la conversion +5 % parce que 40 % des sessions s’arrêtent avant de le voir (scroll map).”

- “Nous pensons que retirer le bandeau “Inscription newsletter” qui occupe le top fold va augmenter le click sur le hero produit +8 % parce que 23 % des visiteurs rage-clic sur le close du bandeau (session recordings).”

Étape 3, A/B test (preuve causale)

Lancez le test sur Statlift (ou autre). Sample size calculé selon votre baseline et votre MDE. Toutes choses égales par ailleurs.

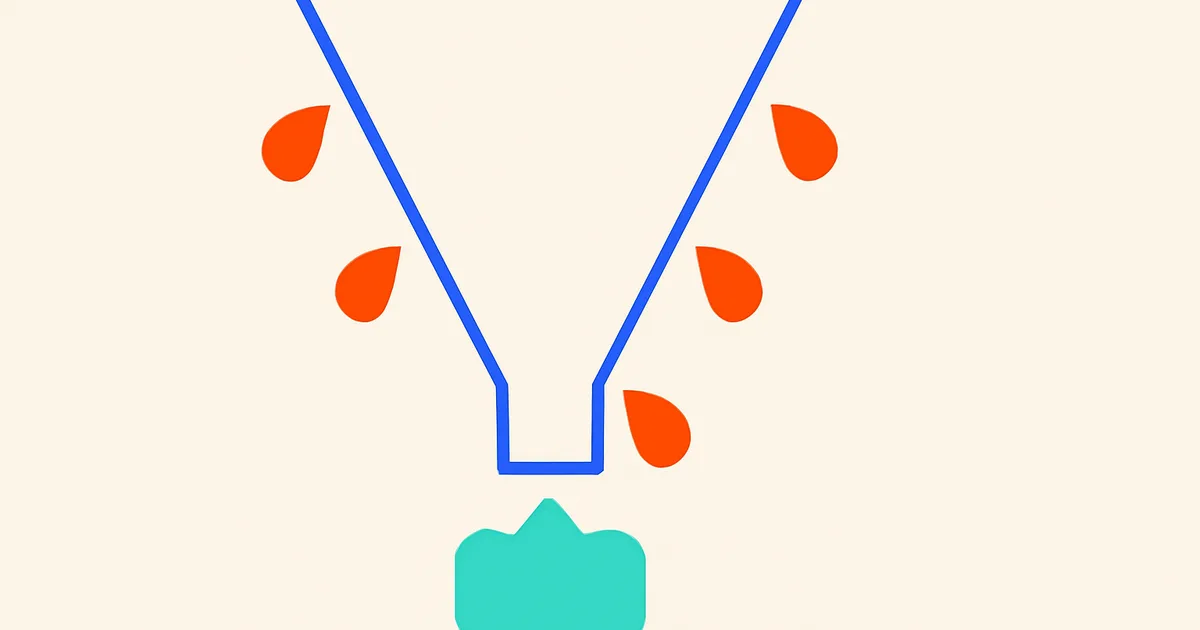

Crucial : si la heatmap génère 5 hypothèses, ne testez pas les 5 simultanément sur la même page. Soit en séquentiel (un test après l’autre), soit en isolant les zones de la page (test header vs test middle vs test footer).

Étape 4, Décision et boucle

3 issues possibles :

- Winner significatif : déployez en rollout progressif (10 % → 50 % → 100 %).

- Perdant significatif : ne déployez pas, mais documentez ce que vous avez appris (= ce qui ne marche PAS sur votre audience).

- Flat : la heatmap a généré une fausse hypothèse. Recommencez l’observation.

Dans chaque cas, revenez sur la heatmap après le test pour valider votre lecture initiale.

Outils complémentaires

Microsoft Clarity (gratuit, illimité)

- Heatmaps + session recordings sans limite

- Dead clicks, rage clicks, excessive scroll détectés automatiquement

- Pas de quota visiteurs

- Limite : intégrations limitées, pas de segmentation avancée

Hotjar (payant)

- Plus mature en ergonomie

- Surveys intégrés

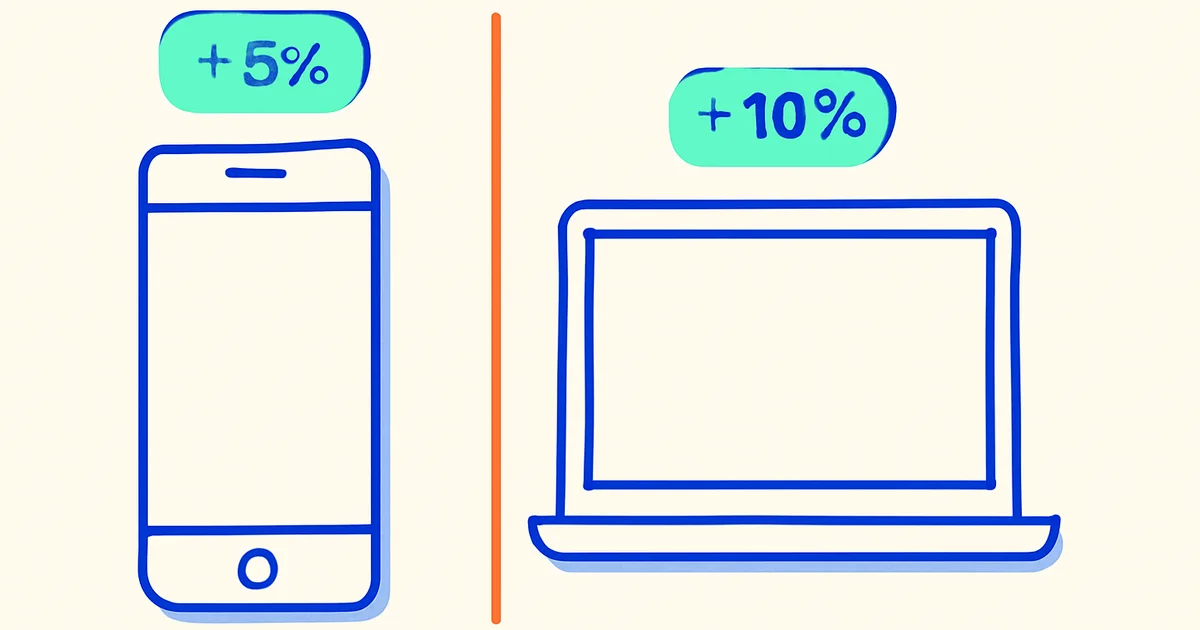

- Better at segmentation par device/source/page

- Limite : payant à partir de 35 K sessions/mois

Microsoft Clarity + Statlift

C’est le combo le plus économique : Clarity gratuit pour observer, Statlift Croissance (79 €/mo) pour tester. Total ~80 €/mois pour un setup CRO complet.

Plan Pro Statlift inclut une intégration native Clarity : les session recordings sont filtrables par variante de test.

Exemple bout-en-bout, Maison Loriot

Septembre 2025, Léa Pernaud (Head of Growth Maison Loriot) installe Clarity sur la PDP. Observation 3 semaines, 142 000 sessions enregistrées.

Insights extraits :

- Scroll map : 38 % des sessions s’arrêtent avant le bloc “avis clients” (situé à 1,5x viewport). Hypothèse : remonter les avis.

- Click map : 12 % de rage clicks sur l’image hero (zoom inexistant). Hypothèse : ajouter zoom.

- Recordings : 8 % des sessions hésitent sur le bouton “Ajouter au panier” mobile (CTA petit et collé au bas du fold). Hypothèse : agrandir le CTA mobile.

A/B tests lancés :

| Test | Résultat | Décision |

|---|---|---|

| Remonter avis au-dessus du fold | +8 %, p = 0,02 | Déployé |

| Ajouter zoom hero | +1,2 %, p = 0,4 | Tué (insight heatmap incorrect) |

| Agrandir CTA panier mobile | +5,5 %, p = 0,01 | Déployé |

Take-aways : 2 winners sur 3 hypothèses générées par heatmap. Le 3ème (zoom) était une fausse intuition, heat de clics ≠ besoin de zoom.

ROI mesurable

Sur Maison Loriot :

- Coût total outils : Clarity (0 €) + Statlift Croissance (79 €/mo) = 79 €/mo

- Gain mesuré : +13,5 % conversion sur les 2 tests déployés

- Revenue additionnel annualisé : ~520 K€

ROI : ~550x sur la 1ère année.

En résumé

| Étape | Outil | Output |

|---|---|---|

| 1. Observation | Clarity / Hotjar | Heatmap + recordings |

| 2. Hypothèses | Cerveau humain + framework PXL | 3-5 hypothèses testables |

| 3. Test | Statlift | Preuve causale (p-value + IC) |

| 4. Décision | Vous | Deploy / Kill / Re-observe |

Trois règles de pouce :

- Les heatmaps génèrent des hypothèses, pas des décisions. Ne déployez jamais “parce que la heatmap dit que”.

- Toujours tester une hypothèse heatmap avant de la déployer. 30-50 % des intuitions sont fausses.

- Combinez gratuit + payant : Clarity gratuit suffit pour l’observation, Statlift Croissance suffit pour tester.

Pour la suite : User research avant A/B test. Pour les fuites funnel : Conversion funnel, les 4 fuites majeures.