Statistique connue de l’industrie : 70 % des tests A/B sortent “flat” (pas de signification statistique). Microsoft a publié cette stat en 2019 (Kohavi & Thomke, HBR), confirmée par Booking et plein d’autres acteurs depuis.

70 % de flat = vous testez beaucoup d’hypothèses sans fondement. Le filtre upstream pour réduire ça : user research.

Pourquoi 70 % de flat ?

Trois causes principales :

- Hypothèses générées par intuition : “Et si on essayait X ?” sans aucune base. Sortie aléatoire = signal flat.

- Sample size insuffisant : test arrêté trop tôt, MDE trop ambitieux. Effet réel existant mais non détecté.

- Hypothèse réelle mais non-impactante : la zone testée pèse peu dans la décision utilisateur.

Le user research s’attaque à la cause #1 et #3, les plus fréquentes.

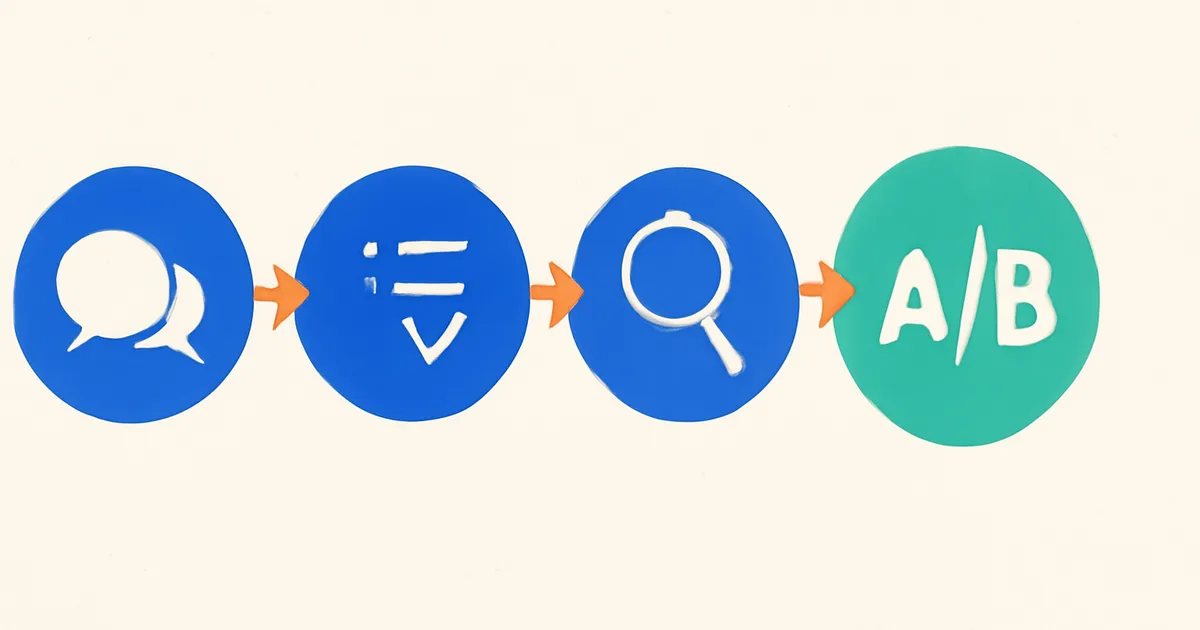

Les 4 méthodes de user research upstream

1. Interviews qualitatives (gold standard)

Format : 30-45 minutes en visio, 5-8 utilisateurs (current + churned + prospects).

Ce que vous cherchez :

- Pain points réels (vs imaginés)

- Vocabulaire utilisé par les users (≠ jargon interne)

- Process décisionnel (qui décide ? sur quoi ?)

- Alternatives considérées (vs vous)

Cadence : 4-5 interviews par trimestre minimum.

Coût : 0 € (juste votre temps).

2. Surveys (à grande échelle)

Format : 5-10 questions, NPS + open text + closed (ratings).

Outils : Tally, Typeform, ou form Google.

Quand l’utiliser : pour valider quantitativement une hypothèse issue des interviews. Ex : si 2 interviewés mentionnent “je ne savais pas que cette feature existait”, survey 100+ users pour mesurer le scope.

Cadence : trimestrielle (NPS) + ad-hoc.

3. Usability tests modérés ou non-modérés

Modéré : vous regardez 5 users utiliser votre produit en live, vous notez les hésitations.

Non-modéré (UserTesting, Maze, Useberry) : vous donnez une tâche, l’utilisateur l’exécute en autonomie, vous récupérez la vidéo + commentaires.

Quand l’utiliser : avant un test A/B sur un parcours critique (checkout, onboarding, signup form). Identifie les frictions concrètes à tester.

Coût : 50-200 € par participant.

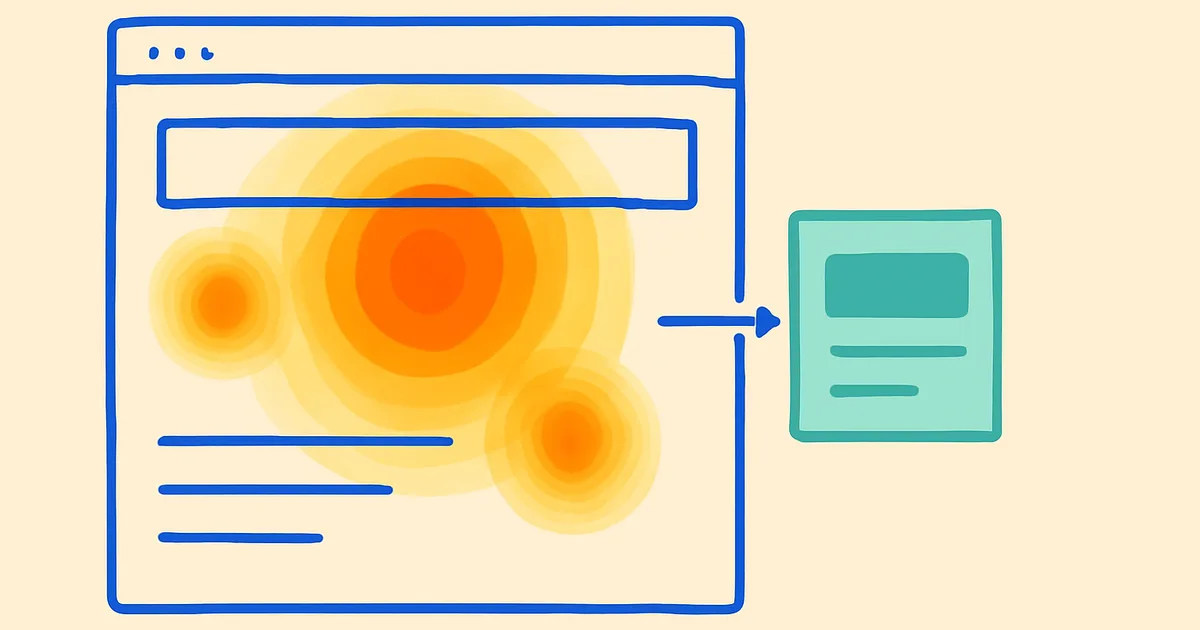

4. Session recordings (passif)

Outil : Clarity (gratuit) ou Hotjar. Voir Heatmaps + A/B testing pour le workflow détaillé.

Avantage : passif (les utilisateurs sont en condition réelle, pas en condition de test).

Limite : pas de “pourquoi”. Vous voyez le clic, pas la motivation.

Le workflow upstream → test A/B

Étape 1, Collecte (continu)

Vous tournez en permanence sur 2-3 méthodes upstream :

- Interviews mensuelles (4 par mois)

- Survey NPS trimestriel

- Session recordings continu via Clarity

Étape 2, Synthèse (mensuelle)

Une fois par mois, fusionnez vos insights dans un doc partagé :

- 5 pain points récurrents observés

- 5 verbatim users (citations directes)

- 5 patterns récurrents dans les recordings

Étape 3, Génération d’hypothèses

À partir de la synthèse, écrivez 10-15 hypothèses testables. Format ICE ou PXL :

ICE (Impact × Confidence × Ease) :

- Impact : si ça marche, quel est le gain ? (1-10)

- Confidence : à quel point êtes-vous sûr que ça marche ? (1-10)

- Ease : facile à implémenter ? (1-10)

Score ICE = somme. Top 3 → testez.

PXL (CXL framework) : pondère plus finement avec Potential, eXecution, Likelihood, Targeting. Plus rigoureux mais plus lent.

Étape 4, Test A/B

Les hypothèses qui ont passé le filtre user research ratent moins :

| Source d’hypothèse | Flat rate observé |

|---|---|

| Intuition pure | 75-85 % |

| Best practice industrie | 60-70 % |

| Heatmap seule | 50-60 % |

| Heatmap + recording | 40-50 % |

| User research complet (interviews + survey + sessions) | 20-30 % |

Sources : meta-analyse Statlift sur 1 200 tests menés par 80 équipes 2024-2025.

Étape 5, Boucle

Les résultats des tests alimentent la prochaine vague de user research :

- Test gagné → comprendre pourquoi (interviews qualitatives)

- Test perdu → comprendre pourquoi (sessions recordings + surveys)

- Test flat → ré-observer (le pattern n’est peut-être pas si fort)

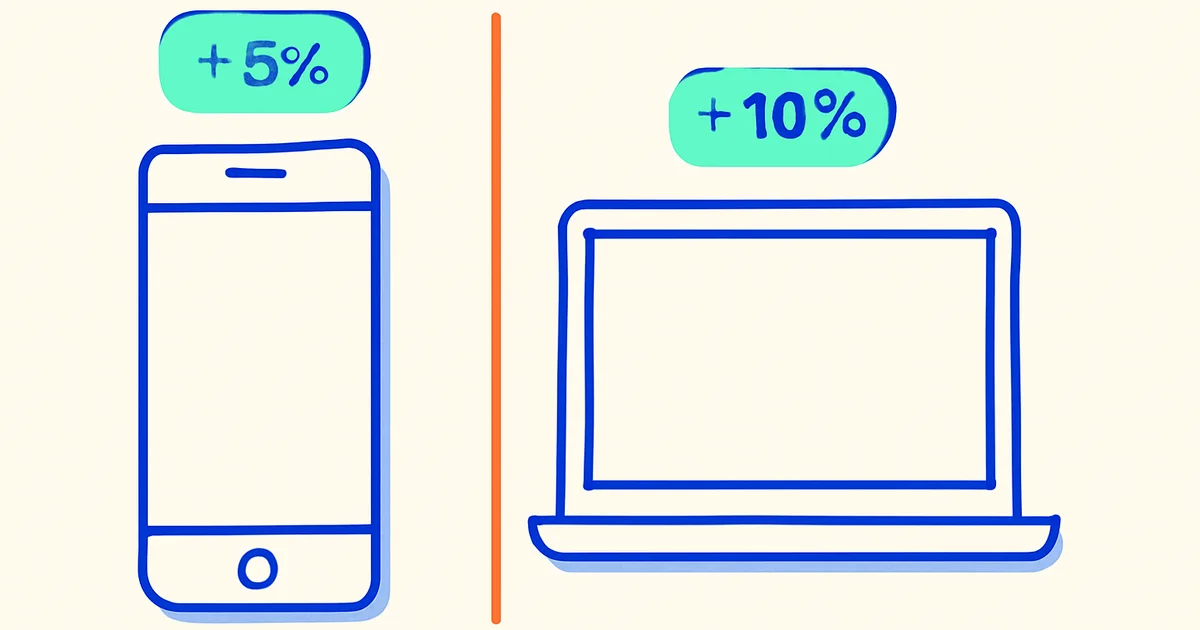

Cas d’usage, Pélican Mobile

Pélican Mobile (média mobile-first, étude de cas) a appliqué ce workflow en 2025.

Avant user research : 2024, 18 tests menés, 6 winners (33 % de win rate). Mais beaucoup d’hypothèses pifométriques.

Après workflow user research : 2025, 16 tests menés, 11 winners (69 % win rate). Augmentation directement attribuable à la qualité supérieure des hypothèses.

Les interviews qualitatives ont révélé que les lecteurs lisent debout dans le métro (= une seule main, viewport tronquée par la barre URL). Plein de tests sur la mobile usability ont suivi.

Erreurs à éviter

Erreur 1, User research seulement quantitative (= surveys)

Les surveys vous disent ce que les users disent vouloir. Ils ne disent pas ce qu’ils font. Le qualitatif (interviews + recordings) capture l’écart.

Erreur 2, Trop de research, jamais de test

Le research alimente les tests, pas l’inverse. Si vous passez 6 mois en interviews sans rien tester, vous accumulez des biais sans les valider.

Cadence : 1 mois de research = 2-3 mois de tests.

Erreur 3, Ignorer la voice of the customer (avis Trustpilot, support tickets)

Les sources gratuites de research existent partout :

- Avis Trustpilot / G2 / Capterra

- Support tickets (categoriser les top 10 sujets récurrents)

- Cancellations surveys (pourquoi les gens churn)

C’est de l’or pour générer des hypothèses. Trop souvent ignoré.

En résumé

| Méthode | Coût | Output | Cadence |

|---|---|---|---|

| Interviews | 0 € | Pain points, vocab, process | 4-5 / mois |

| Surveys | 0 € | Validation quanti | Trimestriel + ad-hoc |

| Usability tests | 50-200 € / user | Frictions concrètes | Avant tests critiques |

| Session recordings | 0 € (Clarity) | Patterns passifs | Continu |

Trois règles de pouce :

- Tournez en continu sur 2-3 méthodes user research, pas seulement quand vous avez “le temps”.

- Documentez les insights dans un doc partagé. Sinon ils s’évaporent en 2 semaines.

- Mesurez votre win rate des tests pré-research vs post-research. Vous devriez voir une amélioration nette.

Pour la suite : Heatmaps + A/B testing combo. Pour le diagnostic funnel : Conversion funnel, 4 fuites majeures.